V današnji digitalni pokrajini je sposobnost ustvarjanja ključnih besed iz besedila bistvenega pomena za SEO, ustvarjanje vsebin in akademske raziskave. Prepoznavanje izrazov in besednih zvez, ki najbolje predstavljajo vašo vsebino, lahko izboljša uvrstitev iskalnikov, racionalizira raziskovalna prizadevanja in usmerja učinkovite vsebinske strategije. Sodobni napredek v obdelavi naravnega jezika za ekstrakcijo ključnih besed naredi ta postopek enostavnejši in natančnejši kot kdaj koli prej, pri čemer orodja, kot je Eskritor , izstopajo kot odlični primeri inovacij.

V tem priročniku bomo raziskali pomen analize besedila za generiranje ključnih besed, se poglobili v različne tehnike, vključno z analizo pogostosti izrazov za ključne besede in uporabo TF-IDF za pridobivanje ključnih besed, ter razpravljali o semantični analizi za ustvarjanje ključnih besed v kontekstu. Izpostavili bomo tudi najboljša orodja za generiranje ključnih besed iz besedila in pripravili navodila po korakih za generiranje ključnih besed.

Zakaj ustvarjati ključne besede iz besedila?

Ekstrakcija ključnih besed podpira različne poklicne naloge - od izboljšanja uvrstitve spletnih strani do kategorizacije raziskovalnih dokumentov. Spodaj je nekaj glavnih razlogov, zakaj je ta proces ključnega pomena za sodobne vsebine in podatkovne strategije.

1 Optimizirajte vsebino za SEO

Ključne besede so hrbtenica vsake učinkovite strategije optimizacije iskalnikov . Z določitvijo najustreznejših izrazov, ki jih uporablja vaše ciljno občinstvo, lahko optimizirate objave v spletnem dnevniku, ciljne strani in drugo spletno vsebino, da se uvrstijo višje v rezultatih iskanja. To ne samo poveča promet, temveč tudi poveča angažiranost uporabnikov z uskladitvijo vsebine z namenom bralca.

2 Povečajte učinkovitost raziskav

Za študente, raziskovalce in podatkovne analitike lahko ekstrakcija ključnih besed znatno skrajša čas, porabljen za presejanje velikih dokumentov ali akademskih člankov. S poudarjanjem glavnih idej in terminologije lahko hitro kategorizirate ugotovitve, poiščete pomembne reference in celo sledite trendom v več študijah. Orodja, kot je Google Scholar dodatno pomagajo pri odkrivanju sorodnih raziskovalnih tem in člankov.

3 Izboljšajte strategijo vsebine

Če razumete, katere ključne besede odmevajo pri vaši ciljni skupini – naj gre za dolge ključne besede za nišne panoge ali splošne izraze z velikim obsegom iskanja – vam pomaga učinkoviteje načrtovati koledar vsebine. To zagotavlja, da vsak kos, ki ga izdelate, govori neposredno o tem, kar iščejo vaši bralci ali stranke, kar na koncu poveča konverzije in zadovoljstvo uporabnikov.

4 Avtomatizacija ročnih postopkov

Minili so dnevi, ko so morale ekipe ročno brskati po straneh in straneh besedila, da bi prepoznale ponavljajoče se teme in besedne zveze. Sodobna orodja za pridobivanje ključnih besed prihranijo čas in zmanjšajo človeške napake z avtomatizacijo celotnega procesa, kar vam omogoča, da se osredotočite na naloge na višji ravni, kot so strategija, analiza in izvajanje.

5 Hitrejše rezultate

Ročna obdelava velikih količin besedila je okorna. AI rešitev, kot je Eskritor, lahko analizira na stotine strani v samo nekaj minutah, kar vam omogoča hitro ponavljanje in hitrejše sprejemanje odločitev na podlagi podatkov.

Pogoste tehnike za generiranje ključnih besed iz besedila

Različne tehnike poskrbijo za različne analitične potrebe, ne glede na to, ali želite preprosto štetje frekvenc ali globlje semantično razumevanje. Raziščimo najpogosteje uporabljene metode in kako pomagajo pridobiti smiselne ključne besede.

1 Analiza frekvence izrazov

Temeljna metoda, pogostost izrazov (TF), opredeljuje najpogosteje uporabljene besede ali besedne zveze v besedilu. Čeprav lahko ta pristop prikaže očitne ključne besede, ne upošteva edinstvenosti ali specifičnosti teh izrazov v več dokumentih.

2 TF-IDF (pogostost izrazov – inverzna frekvenca dokumenta)

TF-IDF izboljša osnovno analizo pogostosti izrazov tako, da upošteva, kako pomemben je izraz v nizu dokumentov. Besede, ki se pogosto pojavljajo v enem dokumentu, redko pa v drugih, prejmejo višjo oceno, zaradi česar je ta tehnika odlična za določanje bolj specializiranih ali kontekstno specifičnih ključnih besed.

3 Semantična analiza

Semantična analiza identificira kontekstualno pomembne fraze s preučevanjem odnosov med besedami in ne le pogosto uporabljenih. To je še posebej uporabno, če želite zajeti sopomenke, sorodne izraze ali tematsko povezane ideje namesto ponavljajočih se besed, ki morda nimajo pomena.

4 Pristopi, ki temeljijo na NLP

Napredne NLP tehnike, kot sta prepoznavanje imenovanih entitet (NER) in modeliranje tem, presegajo preprosto štetje besed. NER identificira ljudi, kraje, organizacije in druge specifične subjekte, ki so lahko ključne ključne besede v novinarstvu ali poslovni analizi. Modeliranje tem razkriva širše teme v besedilu, kar olajša kategorizacijo velikih količin podatkov.

Najboljša orodja za generiranje ključnih besed iz besedila

Pridobivanje ključnih besed je mogoče izvesti z vrsto specializiranih orodij in platform. Spodaj je pregled nekaterih vodilnih možnosti, od katerih je vsaka primerna za različne zahteve uporabnikov – od optimizacije SEO do celovite analize podatkov.

1 Eskritor

Eskritor je napredna, AIusmerjena platforma za pisanje, zasnovana za poenostavitev in izboljšanje procesa ekstrakcije ključnih besed za uporabnike na različnih področjih - ne glede na to, ali optimizirate za SEO, razvijate tržne kampanje ali izvajate akademske raziskave. Z uporabo zmogljivih algoritmov za obdelavo naravnega jezika (NLP) Eskritor samodejno prepozna ključne izraze in besedne zveze v besedilu, pri čemer poudari ključne besede, ki temeljijo na frekvenci, in vpoglede, ki temeljijo na kontekstu.

Glavne značilnosti

- AIorodje za pisanje, prilagojeno za SEO, trženje in akademsko uporabo

- Preprost vmesnik za analizo besedila in ustvarjanje ključnih besed, ki jih je mogoče uporabiti

Zakaj izstopa

- Pospešuje analizo ključnih besed z naprednimi algoritmi NLP

- Ponuja prilagodljive možnosti za frekvenčno filtriranje in semantično analizo

2 Google Keyword Planner

Osnova za digitalne tržnike Google Keyword Planner usklajuje predlagane ključne besede s podatki o obsegu iskanja. Čeprav je namenjen predvsem PPC kampanjam, pomaga tudi ustvarjalcem vsebin, da izboljšajo svoje teme na podlagi resničnih poizvedb uporabnikov. Integracija z Google Ads zagotavlja neposreden vpogled v to, kako pogosto se iščejo določeni izrazi, kar vam daje prednost pri ustvarjanju vsebine, ki ustreza namenu uporabnika.

3 MonkeyLearn

Idealen za analizo besedila, MonkeyLearn omogoča ekstrakcijo ključnih besed z uporabo zmogljivih NLP API-jev. Odlikuje se pri kategorizaciji povratnih informacij, mnenj ali klepetanja v družabnih medijih, zaradi česar je dragocen za blagovne znamke, ki se osredotočajo na analizo razpoloženja in trendov. Nadzorna plošča MonkeyLearnvključuje možnosti za obdelavo v realnem času, kar pomeni, da jo lahko nastavite tako, da nenehno analizira dohodne podatke – kot nalašč za hitre marketinške ekipe ali operacije podpore strankam.

4 Knjižnice R in Python

Za uporabnike, ki so zadovoljni s programiranjem, knjižnice, kot sta Tidytext (R) in spaCy (Python), omogočajo poglobljeno in prilagodljivo ekstrakcijo ključnih besed. Izvajate lahko TF-IDF, modeliranje tem in analizo mnenja za visoko specializirane ali obsežne projekte.

Te knjižnice ponujajo prilagodljivost za natančno nastavitev parametrov ali integracijo z okviri strojnega učenja, zaradi česar so idealne za podatkovne znanstvenike ali raziskovalce, ki potrebujejo popolnoma prilagojen cevovod za analizo besedila.

5 Semrush

Priljubljena izbira med SEO strokovnjaki Semrush združuje raziskave ključnih besed z analizo konkurence. Njegova osredotočenost na obseg iskanja, ocene težavnosti in konkurenčne strategije pomaga izboljšati načrte vsebine za največjo prepoznavnost.

Poleg predlogov ključnih besed Semrush ponuja vpoglede na ravni domene, kot so profili povratnih povezav in analitika prometa, kar omogoča celosten pristop k SEO in taktikam digitalnega trženja.

Vodnik po korakih za ustvarjanje ključnih besed z Eskritor

Ko gre za preprosto, a zmogljivo pridobivanje ključnih besed, Eskritor ponuja odlično ravnovesje med uporabnostjo in naprednimi funkcijami NLP . Tukaj je opisano, kako kar najbolje izkoristiti njegovo platformo.

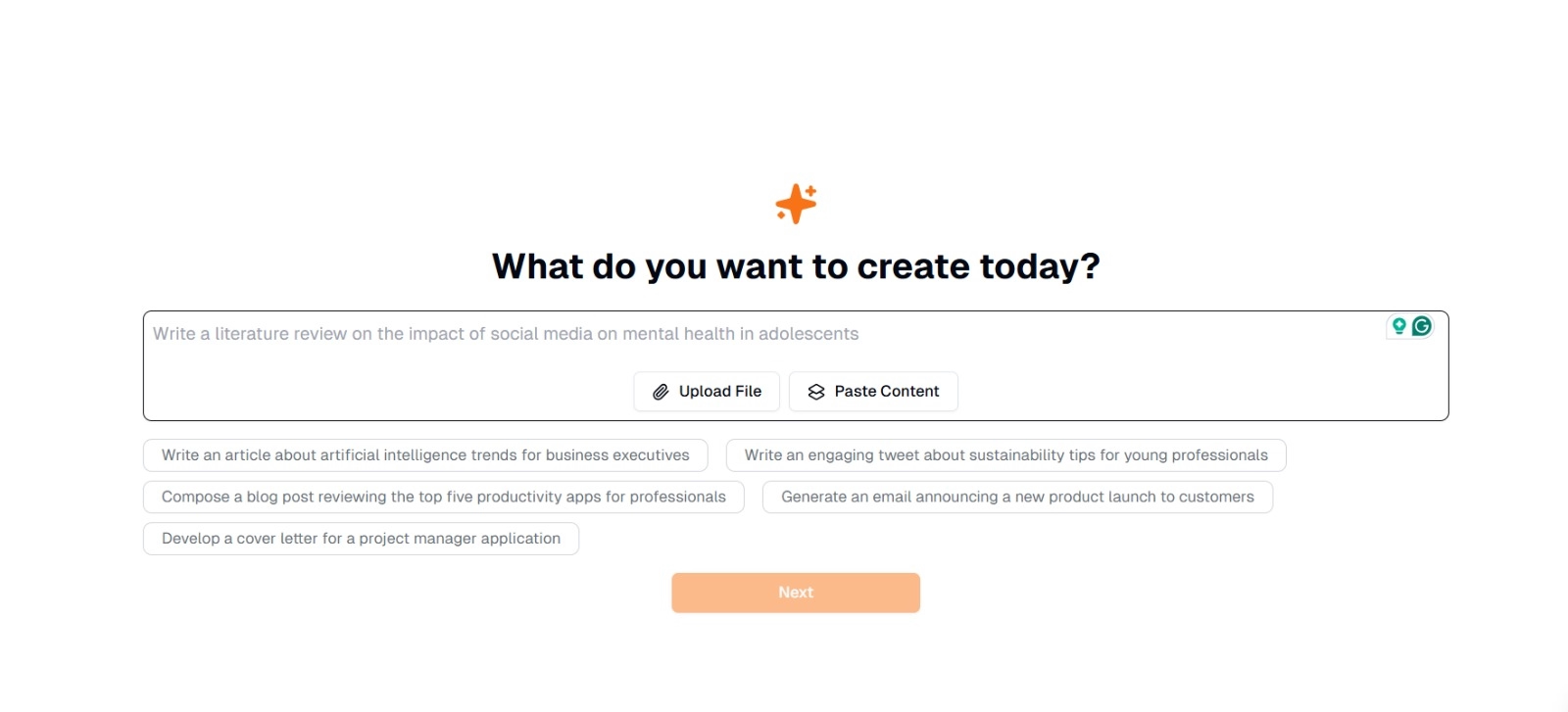

1. korak: vnesite ali naložite besedilo

Na glavnem vmesniku Eskritorboste videli poziv z vprašanjem: "Kaj želite ustvariti danes?" Tukaj imate dve možnosti:

- Prilepi vsebino : Kopirajte in prilepite besedilo neposredno v dano besedilno polje.

- Naloži datoteko : Izberite dokument (npr. .docx, .pdf, .txt), ki vsebuje besedilo, ki ga želite analizirati.

Nasvet : Izbirate lahko tudi med predlaganimi pozivi (npr. »Napišite članek o trendih umetne inteligence ...«), če nameravate ustvariti ali predelati besedilo pred ekstrakcijo.

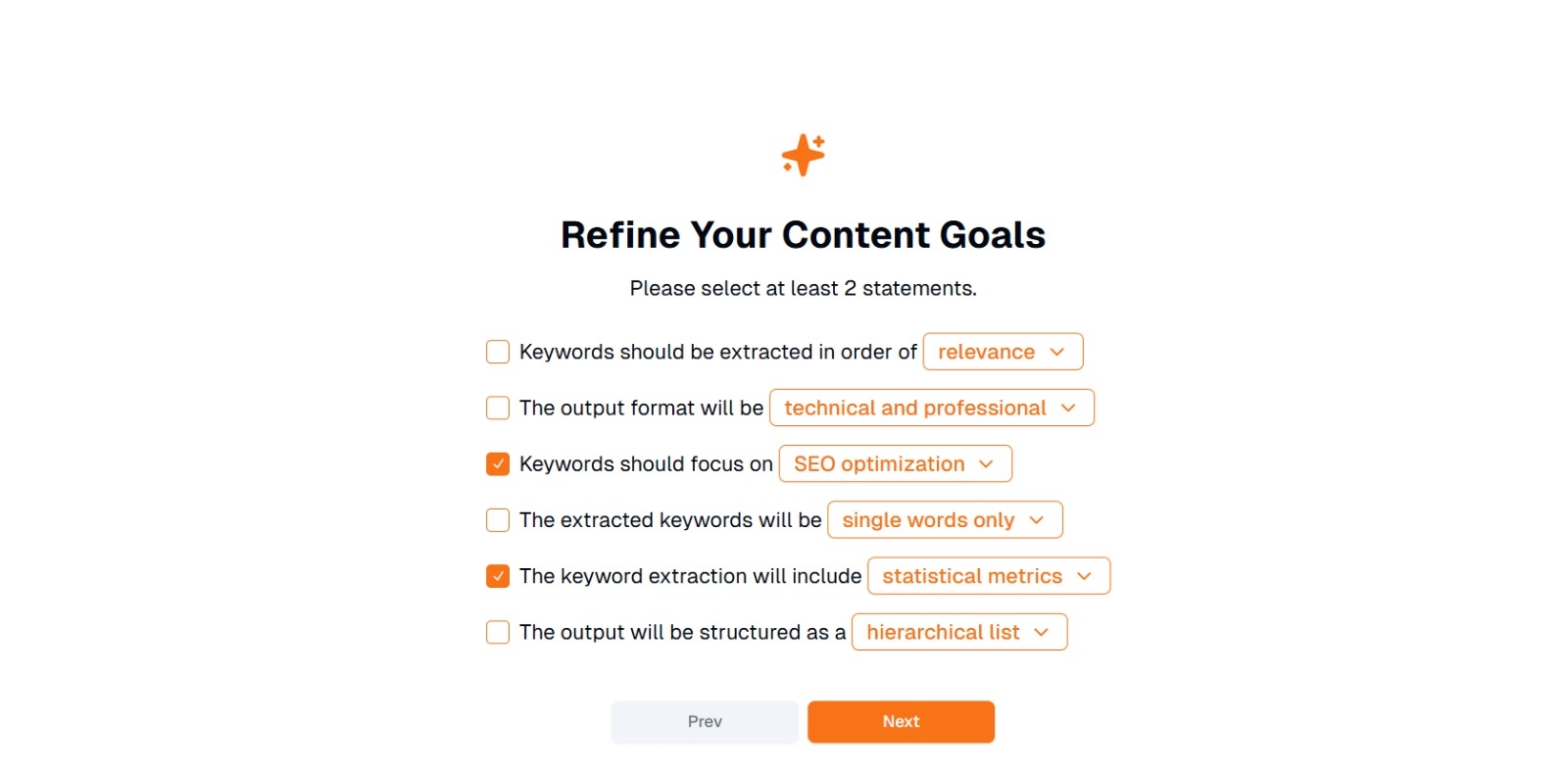

2. korak: Natančneje določite cilje vsebine

Pozvani boste z » Kaj želite storiti s to vsebino? " in prosil, naj izbere vsaj 2 izjavi . Prav tako lahko napišete, kaj želite storiti za klepet. Možnosti lahko vključujejo:

- Ključne besede je treba izvleči v vrstnem redu: (npr. Ustreznost , pogostost , po abecednem vrstnem redu itd.)

- Izhodna oblika bo: (npr. tehnična in strokovna , priložnostna in prijazna )

- Ključne besede se morajo osredotočiti na: (npr. SEO optimizacijo, akademske raziskave, tržne kote)

- Izvlečene ključne besede bodo: (npr. samo posamezne besede , besedne zveze z več besedami )

- Ekstrakcija ključnih besed bo vključevala: (npr. statistične metrike , semantično združevanje )

- Izhod bo strukturiran kot: (npr. hierarhični seznam , preproste oznake )

Nasvet: Izberite izjave, ki najbolje ustrezajo potrebam vašega projekta. Na primer, če optimizirate objavo v spletnem dnevniku za iskalnike, razmislite o preverjanju optimizacijeSEO, samo posameznih besed in izvlečenih po vrstnem redu ustreznosti.

3. korak: Kliknite »Naprej«, da ustvarite ključne besede

Ko natančneje določite cilje in izberete želene možnosti, kliknite Naprej (ali podoben gumb), da začnete pridobivanje ključnih besed. Eskritor AI bo obdelal besedilo z uporabo NLP metod, kot so analiza frekvence izrazov, TF-IDFin semantična analiza (kot je primerno), da bi identificiral najpomembnejše ključne besede.

4. korak: preglejte izvlečene ključne besede

Eskritor bo prikazal seznam (ali hierarhijo) ključnih besed na podlagi izbranih meril. Zaslon lahko vključuje:

- Seznam ključnih besed : razporejeno po ustreznosti, pogostosti ali v hierarhični obliki.

Nasvet : Bodite pozorni na ključne besede, ki jih je morda treba združiti (npr. ednina v primerjavi z množino) ali odstraniti (npr. preveč splošni izrazi).

5. korak: izvozite ali uporabite rezultate

Na koncu izvozite seznam ključnih besed ali ga vključite neposredno v potek dela:

- Možnosti izvoza : Prenesite v PDF, docx ali HTML.

- Primeri uporabe : Integrirajte v SEO orodja, dokumente za načrtovanje vsebine, orise raziskav ali nadzorne plošče za trženje.

Nasveti za učinkovito generiranje ključnih besed

Za to, da je pridobivanje ključnih besed natančno in usklajeno z vašimi cilji, je potrebna strategija. Tukaj je nekaj najboljših praks, ki jih je treba upoštevati.

1 Čiščenje in predobdelava besedila

Pred analizo odstranite stop besede, posebne znake in nepomembne podatke, da se izognete neredu. Orodja, kot so NLTK (Python) ali določeni urejevalniki besedila, lahko avtomatizirajo ta korak predobdelave.

2 Pogostost in ustreznost ravnovesja

Pri ključni besedi ne gre le za to, kolikokrat se pojavi, temveč tudi za kontekstualno pomembnost. Združite meritve frekvence s semantično analizo, da dosežete pravo ravnovesje.

3 Uporabite kombinacijo tehnik

Izkoristite več pristopov –TF-IDF, semantično analizo ali prepoznavanje imenovanih entitet – da zajamete popolnejši obseg ustreznih ključnih besed in zmanjšate slepe točke.

4 Nenehno preizkušanje in izboljševanje

Trendi ključnih besed se lahko sčasoma spremenijo, zlasti v hitro razvijajočih se panogah. Redno posodabljajte ključne besede na podlagi novih podatkov, meritev uspešnosti ali spreminjajočih se potreb ciljne skupine.

Zaključek: Poenostavite generiranje ključnih besed z AI

Ustvarjanje učinkovitih ključnih besed je ključni del sodobnih vsebinskih strategij, raziskovalnih delovnih tokov in nalog analize podatkov. Orodja, ki temeljijo na AI in NLP, kot je Eskritor, so olajšala ekstrahiranje, izboljšanje in izvoz ključnih besed z visoko vrednostjo v delčku časa, ki bi ga potrebovali ročno.

Z združevanjem več tehnik -TF-IDF, semantične analize, modeliranja tem in še več - pridobite celovito razumevanje tega, kaj je resnično pomembno v vašem besedilu. Ta vpogled spodbuja boljše SEO rezultate, bolj osredotočene raziskave in privlačno tržno gradivo. Skratka, pridobivanje ključnih besed na podlagi AIni več izbirno; To je nujno za strokovnjake, ki cenijo učinkovitost, natančnost in odločanje na podlagi podatkov.

Dubaj, ZAE

Dubaj, ZAE